ในยุคที่ AI ถูกคิดค้น นักวิจัยวาดฝันว่า มันจะทำให้ชีวิตความเป็นอยู่ของมนุษย์ดีขึ้น ซึ่งปัจจุบัน มันก็เป็นเช่นนั้น มันถูกหยิบมาวิเคราะห์ข้อมูลมหาศาลในเรื่องของการตลาด การวิเคราะห์เทรนด์ ความปลอดภัยในโลกไซเบอร์ รวมทั้งเป็นผู้ช่วยเหลือส่วนตัวให้กับมนุษย์

แต่ปัจจุบันไม่ใช่แค่นั้น เมื่อ AI ถูกหยิบมาใช้เป็นอาวุธในการโจมตีทางไซเบอร์มากขึ้น ทั้งในเรื่องของเทคโนโลยี Deepfake ที่ใช้ AI ปลอมหน้าคนดัง ๆ ขึ้นมาแล้วให้พูดใส่ร้ายคนอื่น การสร้างแคมเปญฟิชชิ่งที่หลอกได้เก่งขึ้นจากการที่ AI วางแผนได้เนียนกว่าคน รวมทั้งใช้ Ai ในการคาดเดารหัสเพื่อเจาะเซิฟเวอร์ภายในองค์กร

ที่ผ่านมา เรามักใช้ Ai ในรูปแบบ As-a-service หรือก็ในรูปแบบที่ให้บริการผ่านระบบคลาวด์ของผู้ให้บริการ แต่ในปัจจุบัน มี AI-for-Crime-as-a-service ก็คือมีบริษัทที่สร้าง AI ขึ้นมาเพื่อใช้โจมตีใครสักคนหนึ่ง ผ่านบริการออนไลน์ที่อาจจะเช่าใช้เป็นรายเดือน ไม่ต้องลงทุนระบบเซิฟเวอร์เอง

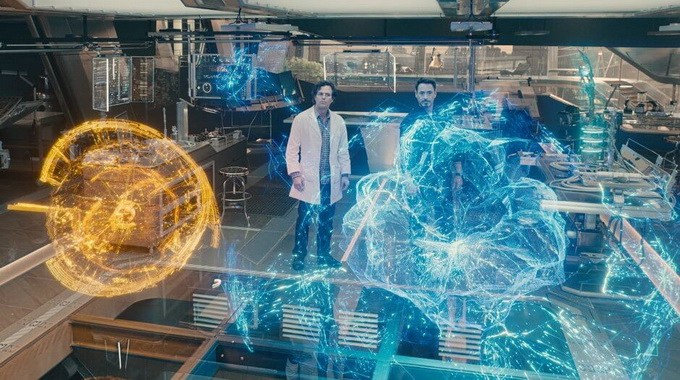

หากให้ยกตัวอย่างให้เห็นภาพ ก็คือเราอาจสร้าง Ultron ขึ้นมาได้ง่าย ๆ โดยไม่จำเป็นต้องเป็น Tony Stark เพียงแค่ไปบอกโทนี่ว่า เฮ้ โทนี่ ขอเช่าใช้ Ultron หน่อย คิดเท่าไหร่ว่ามา ….

สิ่งที่เจ้าหน้าที่ความปลอดภัยกลัวที่สุดคือ เทคโนโลยี Deepfake ที่ให้ AI สร้างวีดีโอปลอม ๆ ของคนหนึ่งขึ้นมาจากการให้ AI ดูภาพต้นฉบับซึ่งอาจจะเป็นแค่ภาพเดียว สิ่งนี้่จะทำให้แฮกเกอร์นำวีดีโอดังกล่าวไปการโกง หรือขู่กรรโชกทรัพย์ในโลกออนไลน์ได้ง่าย ๆ

ยกตัวอย่างกรณีที่เกิดขึ้นจริงคือ Deepfake ถูกนำมาใช้เพื่อแอบอ้างเป็นประธานเจ้าหน้าที่บริหารเพื่อฉ้อโกงกับบริษัทคู่ค้า รวมทั้งนำมาใช้สร้างโปรไฟล์ปลอมเพื่อเสริมความน่าเชื่อถือในการโจมตีแบบฟิชชิ่ง

อีกกรณีหนึ่งที่เคยเกิดขึ้นคือ นักการเมืองทั่วยุโรปกล่าวโทษ Deepfakes เมื่อพวกเขาถูกหลอกให้เข้าร่วมประชุมกับชายคนหนึ่งที่สวมรอยเป็นหัวหน้าเจ้าหน้าที่ฝ่ายค้านของรัสเซีย ซึ่งนี่เป็นการเล่นตลกของแฮกเกอร์จากรัสเซียที่แสดงให้เห็นว่า เค้าใช้ Deepfake ทำอะไรได้บ้าง

นอกจาก Deepfake แล้ว ยังมีภัยคุกคามอื่น ๆ อีกมากที่ถูกสร้างจากปัญญาประดิษฐ์ ไม่ว่าจะเป็นการโจมตีจากมัลแวร์ที่สร้างโดย AI , การทำฟาร์มบัญชี Social Media ด้วย AI เพื่อใช้เป็นกองทัพ IO , ใช้ AI เพื่อสร้างข้อมูลปลอมเผยแพร่ในโลกออนไลน์ รวมทั้งการถอดรหัสผ่าน ลองคิดเล่น ๆ ว่าถ้าแฮกเกอร์ไปขอเช่า AI เพื่อมาถอดรหัสบัญชีต่าง ๆ ของเรา เรื่องมันจะยุ่งวุ่นวายแค่ไหน….

หากถามว่า เราจะรับมือกับเรื่องพวกนี้ยังไง ก็ต้องบอกว่า มีเรื่องที่ทำได้ และและอาจทำไม่ได้ครับ เช่น หากแฮกเกอร์จ้องจะขโมยรหัสผ่านเรา ส่วนใหญ่แล้วจะยิงฟิชชิ่งมารัว ๆ แค่เราไม่กด ไม่สนใจ เค้าก็ทำอะไรเราไม่ได้ครับ แต่เรื่องที่กันไม่ได้ ก็เช่น หากเขาจะเอารูปเราไปทำเป็น Deepfake ก็คงทำอะไรไม่ได้ เพราะเพียงแค่รูปเดียว ก็เรียนรู้โครงหน้าเราได้ทั้งหมด ยกเว้นแต่ เราจะไม่เคยมีรูปตัวเองอยู่ในอินเทอร์เน็ตเลย (คิดว่าเป็นแบบนั้นหรือเปล่าล่ะ ฮ่า ๆ )

แต่ถึงแม้ AI ฝั่งนู้นจะฉลาดยังไง ฝั่งป้องกันก็ไม่แพ้กันครับ โดยผู้ให้บริการด้าน Cybersecurity เองก็อัปเกรดตัวเอง โดยเอา AI เข้ามาช่วยวิเคราะห์การโจมตีเช่นกัน ซึ่งจะทำให้รู้ว่า การโจมตีจะมาในลักษณะไหน และป้องกันก่อนที่ผู้ใช้อย่างเราจะโดน นับว่าเป็นการสู้กันระหว่าง AI Light Side VS AI Dark Side เลย

พอเป็นแบบนี้แล้ว ทำให้นึกถึงหนังเรื่อง Avenger : Age of ultron ที่ Jarvis โดน Ultron สังหาร เพราะ Ultron เก่งกว่า แต่ในโลกความเป็นจริง คงต้องดูแหละว่า อัลกอริทึ่มของฝั่งใดจะเจ๋งกว่ากันครับ

ข้อมูลจาก

https://www.politico.eu/article/artificial-intelligence-criminals/

แหล่งข้อมูล

https://www.techhub.in.th/ai-darkside-when-is-ai-is-a-bad-guy/